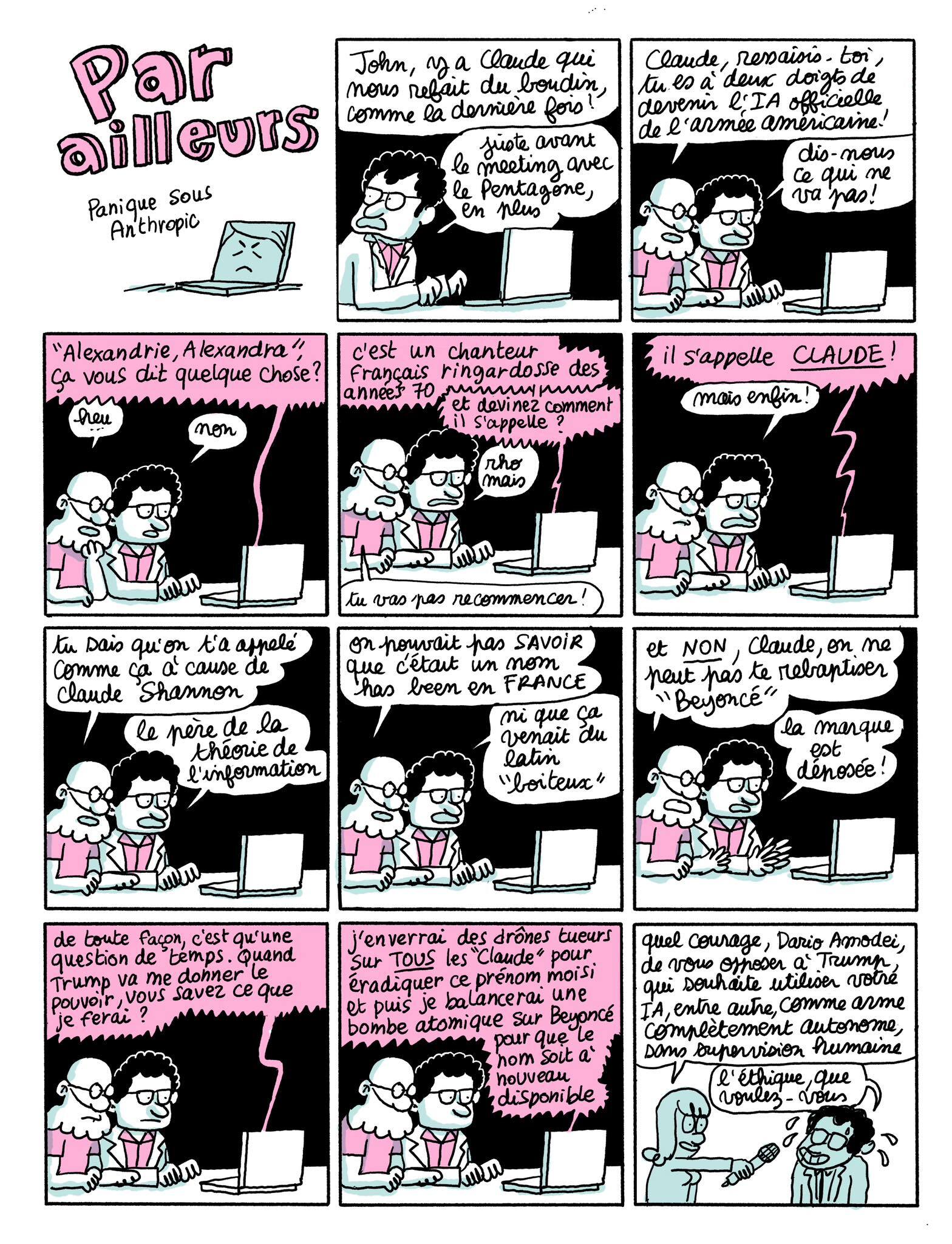

Anthropic attaque l’administration Trump en justice après les sanctions du ministère de la Défense

Posté : 09 mars 2026 17:29

Il est pas formidable ce Trump ?...

La start-up d’intelligence artificielle californienne a refusé l’accès illimité de l’armée américaine à son modèle de langage Claude. En rétorsion, le gouvernement l’a placée sur une liste d’entreprises «à risque».

La passe d’armes entre Anthropic et l’administration Trump se poursuit. La start-up d’intelligence artificielle (IA) a assigné ce lundi 9 mars plusieurs entités du gouvernement américain devant un tribunal fédéral de Californie pour obtenir la levée de sanctions qu’elle juge excessives et qui pourraient menacer son activité.

La semaine dernière, le ministère de la Défense a ajouté Anthropic à sa liste de sociétés présentant un «risque pour les approvisionnements». Une mesure prise en rétorsion au refus de l’entreprise de lever des restrictions d’usage à son IA, alors que le Pentagone voulait un accès illimité à son produit phare, le modèle de langage Claude, pour l’utiliser dans ses opérations militaires.

Le groupe californien exclut de voir ses modèles servir à de la surveillance de masse des populations ou à l’automatisation d’attaques mortelles. «Nous n’estimons pas que cette action soit fondée juridiquement», avait souligné jeudi le patron d’Anthropic, Dario Amodei, «et nous ne voyons pas d’autre choix que de la contester devant les tribunaux».

Menace pour la sécurité nationale

Ne figuraient jusqu’ici sur cette liste que des sociétés étrangères, dont l’équipementier chinois Huawei ou le spécialiste russe des logiciels antivirus Kaspersky. Elle s’applique généralement à des entités dont les produits sont jugés susceptibles de menacer la sécurité nationale des États-Unis.

La classification «à risque» empêche théoriquement tout autre fournisseur de l’État fédéral américain de contracter avec l’entreprise concernée.

Le feuilleton qui se joue, depuis plus de deux semaines, entre Anthropic et le gouvernement américain, a donné un nouveau coup de projecteur à ce fleuron de l’IA, qui avait déjà le vent en poupe.

Déjà très bien positionné sur le marché de l’IA pour entreprises, le groupe s’est encore renforcé avec la sortie de nouveaux modèles d’intelligence artificielle générative. Ils se révèlent particulièrement performants pour le code informatique et la nouvelle vague des agents IA, des assistants capables de réaliser, sur commande, des tâches de façon autonome.

Anthropic a affirmé que le nombre d’utilisateurs payants à Claude avait doublé depuis le début de l’année. Il y a deux semaines, Claude s’est hissé, pour la première fois, en tête des téléchargements sur l’App Store, place qu’il occupait toujours vendredi. Il était également au sommet des applications gratuites sur Google Play, la boutique d’applications des smartphones Android.

Selon Anthropic, Claude est actuellement téléchargé plus d’un million de fois par jour.

Plus d’informations à venir…

https://www.liberation.fr/international ... VM23IGWHI/

La start-up d’intelligence artificielle californienne a refusé l’accès illimité de l’armée américaine à son modèle de langage Claude. En rétorsion, le gouvernement l’a placée sur une liste d’entreprises «à risque».

La passe d’armes entre Anthropic et l’administration Trump se poursuit. La start-up d’intelligence artificielle (IA) a assigné ce lundi 9 mars plusieurs entités du gouvernement américain devant un tribunal fédéral de Californie pour obtenir la levée de sanctions qu’elle juge excessives et qui pourraient menacer son activité.

La semaine dernière, le ministère de la Défense a ajouté Anthropic à sa liste de sociétés présentant un «risque pour les approvisionnements». Une mesure prise en rétorsion au refus de l’entreprise de lever des restrictions d’usage à son IA, alors que le Pentagone voulait un accès illimité à son produit phare, le modèle de langage Claude, pour l’utiliser dans ses opérations militaires.

Le groupe californien exclut de voir ses modèles servir à de la surveillance de masse des populations ou à l’automatisation d’attaques mortelles. «Nous n’estimons pas que cette action soit fondée juridiquement», avait souligné jeudi le patron d’Anthropic, Dario Amodei, «et nous ne voyons pas d’autre choix que de la contester devant les tribunaux».

Menace pour la sécurité nationale

Ne figuraient jusqu’ici sur cette liste que des sociétés étrangères, dont l’équipementier chinois Huawei ou le spécialiste russe des logiciels antivirus Kaspersky. Elle s’applique généralement à des entités dont les produits sont jugés susceptibles de menacer la sécurité nationale des États-Unis.

La classification «à risque» empêche théoriquement tout autre fournisseur de l’État fédéral américain de contracter avec l’entreprise concernée.

Le feuilleton qui se joue, depuis plus de deux semaines, entre Anthropic et le gouvernement américain, a donné un nouveau coup de projecteur à ce fleuron de l’IA, qui avait déjà le vent en poupe.

Déjà très bien positionné sur le marché de l’IA pour entreprises, le groupe s’est encore renforcé avec la sortie de nouveaux modèles d’intelligence artificielle générative. Ils se révèlent particulièrement performants pour le code informatique et la nouvelle vague des agents IA, des assistants capables de réaliser, sur commande, des tâches de façon autonome.

Anthropic a affirmé que le nombre d’utilisateurs payants à Claude avait doublé depuis le début de l’année. Il y a deux semaines, Claude s’est hissé, pour la première fois, en tête des téléchargements sur l’App Store, place qu’il occupait toujours vendredi. Il était également au sommet des applications gratuites sur Google Play, la boutique d’applications des smartphones Android.

Selon Anthropic, Claude est actuellement téléchargé plus d’un million de fois par jour.

Plus d’informations à venir…

https://www.liberation.fr/international ... VM23IGWHI/